چندین نظرسنجی نشان میدهد که چگونه شرکتهای هوش مصنوعی به آفریقا، گاهی اوقات در شرایط اسفناکی، برونسپاری میکنند.

به گفته تحقیق آموزنده توسط تایم. استفاده از هوش مصنوعی (AI) اینترنت را متحول کرده است. اما تصور اینکه رباتهای ساده موفق به ایجاد این نوع جدید از اپلیکیشن شدهاند اشتباه است: با انتشار اظهارات خشونتآمیز، جنسیتی و نژادپرستانه، باید هوش مصنوعی را آموزش داد، که اطلاعاتی را از وب پر از اظهارات تبعیض آمیز به دست میآورد. OpenAI، خالق ChatGPT، دارد ده ها هزار متن را برای یک شرکت کنیایی ارسال کرد. ماموریت پیمانکاری فرعی در نوامبر 2021 آغاز می شد.

در حالی که سما یک شرکت مستقر در سانفرانسیسکو است، کارگرانی را در کنیا، اوگاندا و هند استخدام می کند. و برای گوگل، متا و مایکروسافت کار می کند. در حالی که خود را به عنوان شرکتی معرفی می کند که برای "هوش مصنوعی اخلاقی" کار می کند و ادعا می کند که به نجات بیش از 50 نفر از فقر کمک کرده است، واقعیت ها متفاوت است: پیمانکاران OpenAI بین 000،1,32 تا 2 دلار در ساعت درآمد دارند.

OpenAI اذعان میکند: «مأموریت ما اطمینان از این است که هوش مصنوعی به نفع تمام بشریت باشد و ما سخت کار میکنیم تا سیستمهای هوش مصنوعی ایمن و مفیدی بسازیم که سوگیری و محتوای مضر را محدود میکند». اما این کار سخت در واقع مختص «دستهای کوچک» آفریقایی است. ماموریتی که به کنیاییها سپرده شده است، یادآوری است چگونه فیس بوک از کارکنان برای تعدیل محتوای خود سوء استفاده می کند.

"شکنجه"

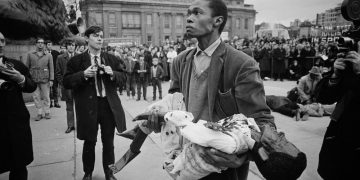

یکی از کارمندان سما که مسئول خواندن مطالب وحشیانه است، خلاصه میکند: «این شکنجه است». به طوری که در فوریه 2022، هشت ماه قبل از پایان قرارداد، سما به دلیل شرایط وحشتناک کاری، قرارداد فرعی خود را به هم زد. به گزارش تایم، سما برای ماموریت خود 200 دلار به جیب زد، حدود 000 کنیایی مجبور شدند مطالب پر از سوء استفاده جنسی، سخنان نفرت انگیز و خشونت را بخوانند. مشاوره در "بهزیستی" در اختیار کارکنان قرار گرفته و سما تضمین می کند «درمانگران سلامت روان حرفه ای آموزش دیده و دارای مجوز» را استخدام کرده اند. چیزی که کارمندان با آن مخالفت می کنند.

فراتر از سختی های روانی، شرایط کاری استارت آپ بود که تکان دهنده بود: به گزارش تایم، در حالی که در کنیا حداقل دستمزد اجباری وجود ندارد، پیمانکاران OpenAI به سختی به اندازه یک مسئول پذیرش در نایروبی درآمد داشتند. " کلمان لودک، جامعه شناس دیجیتال، و ماکسیم کورنت، دانشجوی دکترای جامعه شناسی هوش مصنوعی، بیان می کنند که وظایف وقت گیر و کم ارزش به طور کلی توسط شرکت های فناوری به تعدادی از کارگران ناامن، که عموماً در کشورهای جنوبی مستقر هستند، برون سپاری می شود.

آنها ماموریت مشابهی را در ماداگاسکار پیدا کردند که مربوط به کار داده بود. "مطالعه ما همچنین واقعیت "هوش مصنوعی به سبک فرانسوی" را نشان می دهد: از یک طرف، شرکت های فناوری فرانسوی برای دسترسی به خدمات میزبانی داده و قدرت محاسباتی به خدمات GAFAM متکی هستند. از سوی دیگر، فعالیتهای مرتبط با دادهها توسط کارگران مستقر در مستعمرات سابق فرانسه، بهویژه ماداگاسکار انجام میشود، بنابراین منطقهای قدیمی را از نظر زنجیرههای برونسپاری تأیید میکند.»

نامرئی شدن پیمانکاران فرعی

مشکل: کارگران آفریقایی "در انتهای یک زنجیره طولانی برون سپاری قرار دارند، که تا حدی دستمزد پایین این کارگران ماهر را توضیح می دهد". در مورد شرکت ها، آنها به طور کلی توسط خارجی ها نگهداری می شوند. از 48 شرکت ارائه دهنده خدمات دیجیتال در مناطق آزاد، که توسط این دو محقق مورد مطالعه قرار گرفته است، به سختی 9 شرکت متعلق به مالاگاسی در مقابل 26 شرکت فرانسوی هستند.

به گفته این دو محقق، این الگو یادآور چیزی است که محقق یان پادیوس آن را "یادآوری استعماری" می نامد. کشورهای مستعمره سابق دارای مهارت های زبانی و نزدیکی فرهنگی با کشورهایی هستند که شرکت های خدماتی از آنها دستور می دهند. یک پسااستعماری اقتصادی، که متأسفانه اغلب منجر به نامرئی شدن کارکنان هوش مصنوعی میشود که بدون این بررسیها، همیشه در بینامی کامل خواهند بود.

![[سرمقاله] 30 سال بعد، آیا آپارتاید واقعاً تمام شده است؟](https://lejournaldelafrique.com/wp-content/uploads/2021/06/caricature-jda-apartheid-360x180.jpg)

![[سرمقاله] گابن و کشورهای مشترک المنافع: هوس های شاهزاده علی](https://lejournaldelafrique.com/wp-content/uploads/2021/06/caricature-JDA-Bongo-360x180.jpg)

![[سرمقاله] فیس بوک و توییتر، دیکتاتورها بیشتر از دیکتاتورها؟](https://lejournaldelafrique.com/wp-content/uploads/2021/06/Caricature-JDA-FB-TW-360x180.jpg)

![[سرمقاله] رواندا: برای عذرخواهی فرانسوی ها، لازم است به عقب برگردیم](https://lejournaldelafrique.com/wp-content/uploads/2021/05/Caricature-rwanda-JDA-360x180.jpg)

![[سرمقاله] گینه: آلفا کوند، مظلوم تبدیل به ظالم شد](https://lejournaldelafrique.com/wp-content/uploads/2021/05/Caricature-Alpha-Conde-360x180.jpg)

![[سرمقاله] CFA Franc: یک لیفت صورت سفارشی برای فرانسه](https://lejournaldelafrique.com/wp-content/uploads/2021/05/Caricature-JDA-CFA-360x180.jpg)

![[سرمقاله] ریاض محرز: یک، دو، سه، زنده باد الجزایر!](https://lejournaldelafrique.com/wp-content/uploads/2021/05/caricature-Mahrez-360x180.jpg)

![[سرمقاله] نیجر: محمد بازوم یک عمل متعادل کننده ظریف را آغاز می کند](https://lejournaldelafrique.com/wp-content/uploads/2021/04/image_6483441-1-360x180.jpg)